智能汽車座艙發展主要經歷了四個階段:包括電子座艙階段、智能助理階段、人機共駕階段、第三生活空間。

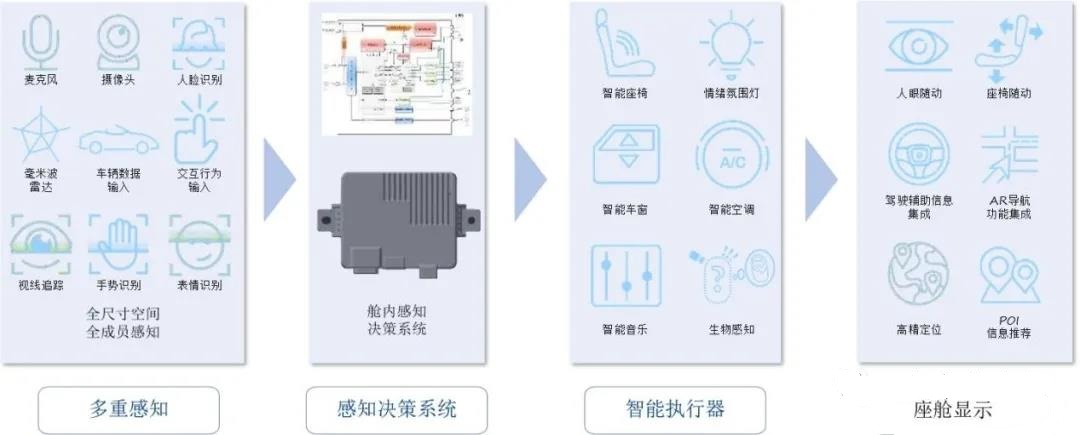

當前隨著智能汽車在AI算法、智能駕駛上的不斷發展進入了L3級自動駕駛的“人機共駕階段”。在智能座艙的表現形式為該階段包含對語音控制和手勢控制技術突破,車內軟硬件一體化聚合,實現車輛感知精細化,車輛可在上車-行駛-下車的整個用車周期中,為駕乘人主動提供場景化的服務,實現機器自主/半自主決策。AI座艙核心價值將表現為基于場景的主動化交互和服務,很多也被稱之為SOA的智能車服務。

傳統座艙引入各種輔助駕駛功能之后,要求駕駛員能夠熟練掌握駕駛艙的交互方式,能夠了解系統的能力與使用限制,能夠理解系統的輸入/輸出關系,在此基礎上決定如何操控輔助駕駛系統。在后續下一代架構中,智能座艙將實現語音控制和手勢控制技術突破,基于多種模式感知手段的融合,使感知更精準和更主動。

一,智能座艙基礎架構解析

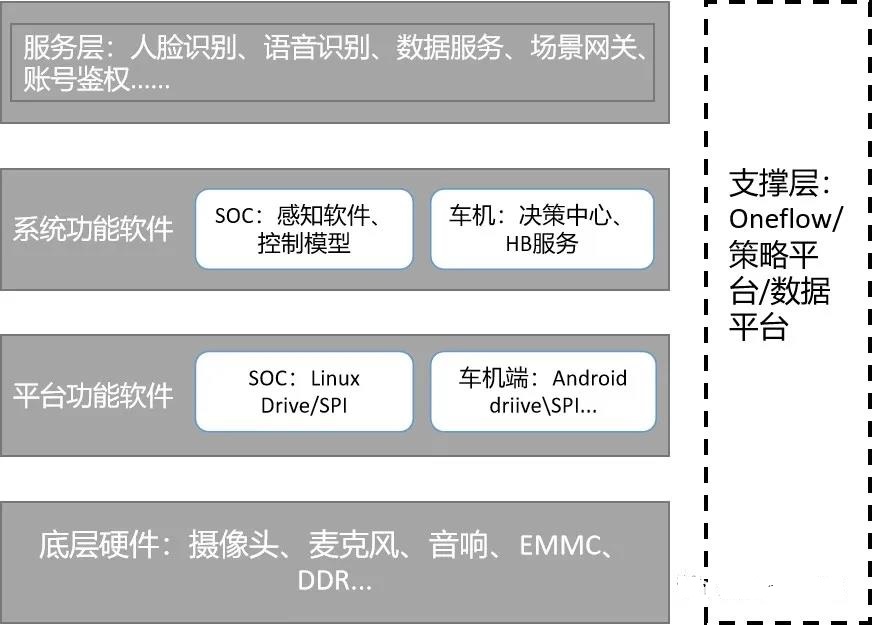

整個智能座艙架構參照3層模型構成,其中底層是硬件層,包含攝像頭,麥克風陣列,內嵌式存儲器(磁盤)EMMC、內存DDR等;中間層是系統軟件層,包含操作駕駛域系統驅動(Linux/QNX Drive)與座艙域系統驅動(Android Drive\SPI);中間層之上是功能軟件層,包含與智能駕駛公用部分的感知軟件,智能座艙自身域的感知軟件,功能安全分析層。車機端的在向上層是服務層,包含啟用攝像頭人臉識別、自動語音識別、數據服務、場景網關、賬號鑒權等。

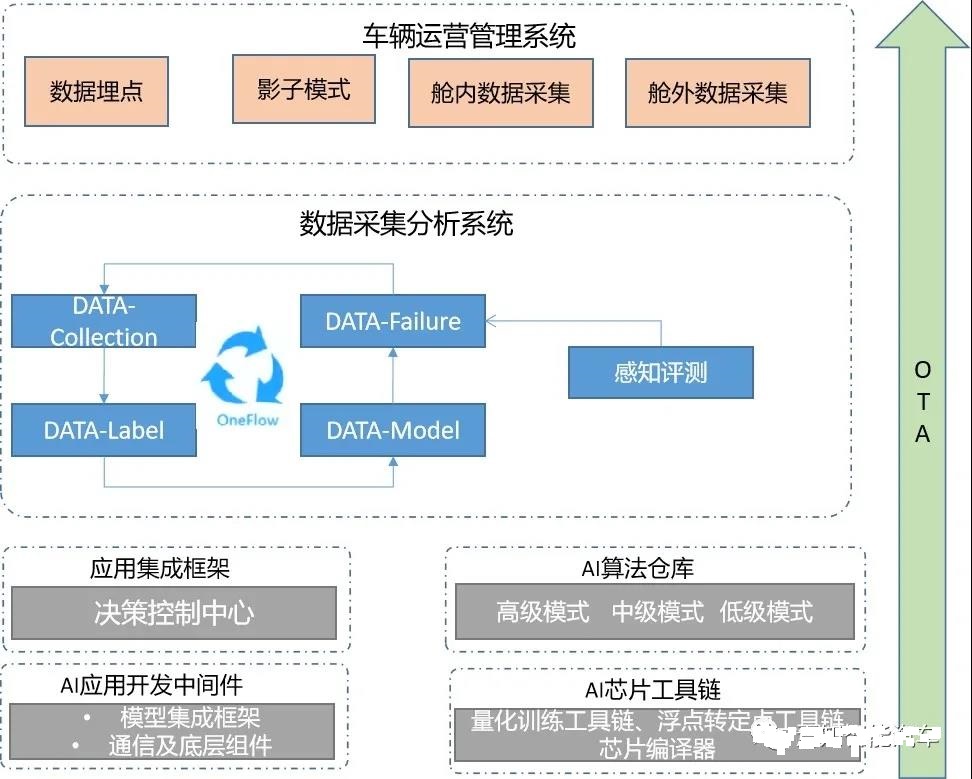

座艙AI智能交互系統是一個獨立系統,獨立迭代,每月OTA。整個智能座艙系統架構可以參考如下設計模型進行相應的信息交互。與智能駕駛域不同,智能座艙域更偏向于交互層級,也即更加重視智能互聯。因此對于網絡通信、數據流等信息更加重視。

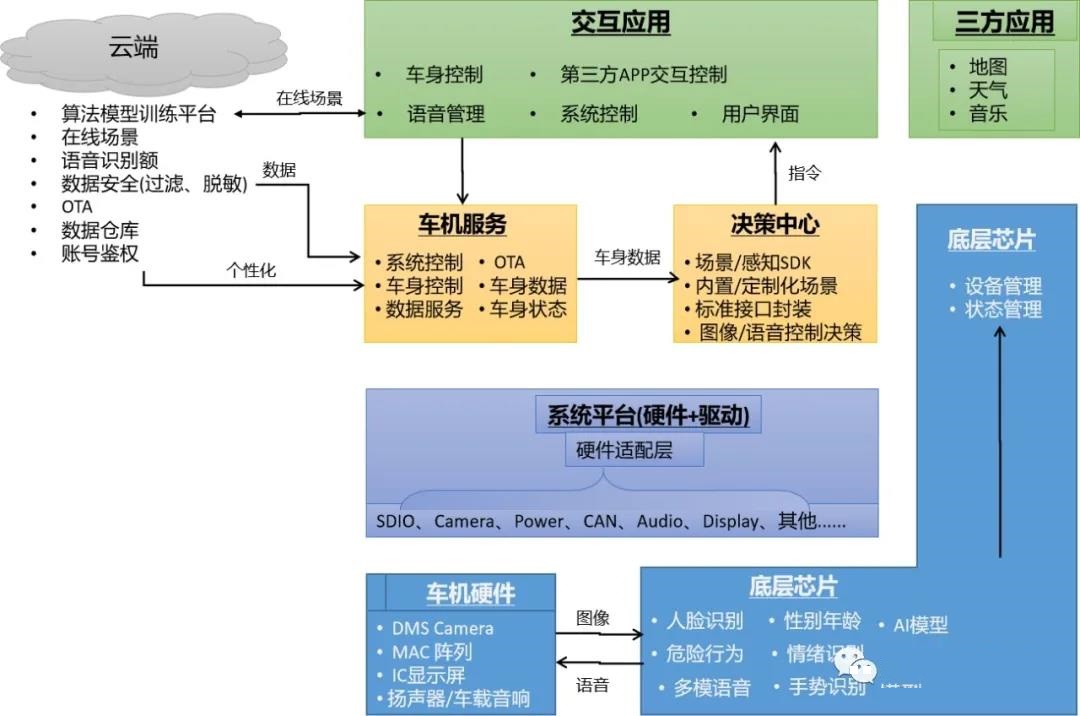

從下到上整體智能座艙系統包括如下幾個大的控制單元應用:

1、車機硬件

車機硬件主要是原始感光或應聲部件,用于接收DMS攝像頭輸入的駕駛員面部或手部信息及OMS輸入的乘員信息。同時,接收車內乘員輸入的相關語音信息,車載音響、顯示等硬件單元。

2、圖像或語音處理芯片

這里的圖像或語音處理芯片功能包含對人臉識別、情緒識別、手勢識別、危險行為識別、多模語音、功能算法等應用。

-

感知軟件:包含多模感知算法、數據閉環的數據埋點、插件管理和基礎組件

-

功能安全:實現芯片處理的硬件級別及軟件級別的功能安全分析及構建

-

系統管理:包括底層OTA、配置組件、功能安全、診斷、生命周期控制等

-

公共管理:基本日志、鏈路、配置等軟件管理

3、系統及中間件平臺

與智能駕駛類似,智能座艙在系統平臺層面需要建立硬件適配及驅動控制,包含進行安全數字輸入輸出單元、電源能量分配、編解碼、音頻輸出、顯示、can通信等單元。

4、車機服務

作為智能座艙的核心服務,則更加依賴于車機服務進行相應的能力控制。整個車機服務包括系統控制、車身控制、數據服務、OTA、底盤狀態及車身數據等內容。

具體說來實現如下功能:

-

AI芯片管理:包含該AI芯片級以上的系統管理與配合,進行進程監控、OTA、HBSerrvice

-

感知數據軟件包SDK:包含接收傳感器感知數據結果,融入AI芯片算法中,并提供數據包Pack的錄制功能

-

控制軟件包SDK:提供軟件生命周期管理,感知算法控制開關,錄制開關等功能

-

應用框架:完成相關業務流程,比如場景定義、多模態語義解析等

-

業務層:在應用框架之上,完成相關業務實現過程,比如FaceID注冊,工作模式定義、OTA、數據閉環等

-

數據服務:包含數據管理、數據處理、數據挖掘、數據回灌;數據指標評測、診斷管理;模型訓練、模型測試、模型管理;數據標注、標注管理等一系列服務。

5、決策中心

決策中心包括通過感知SDK建立場景SDK,從而構建定制化場景及圖像/語音感知能力。

多模態座艙交互技術總體包含:語音+手勢+視線智能人機交互系統。這里我們把圖像和語音感知處理能力統稱為多模態交互應用技術框架。其處理過程包含定義車身數據庫、車內感知數據庫,并進行用戶交互行為數據庫構建,開發用于云端場景推薦匹配SDK,后續用于解決全場景聯調服務推薦功能。進一步的,采集用戶典型場景行為數據,將實際用戶行為數據輸入個性化配置引擎可推動實現端上場景SDK。最終解決車控、音樂、支付等常規服務推薦功能。

6、交互應用

整個交互應用包括車身控制、系統控制、第三方APP交互控制、語音播報、用戶界面等幾個方面。同時,對于第三方應用中的地圖、天氣、音樂等也有一定要求。

7、云端服務

由于大量的數據涉及遠程傳輸和監控,且智能座艙的大算力算法模塊處理也更加依賴云端管理和計算能力。智能座艙云端服務包括算法模型訓練、在線場景仿真、數據安全、OTA管理、數據倉儲、賬號服務等。

-

場景網關:融合多個服務,比如駕駛員監控的faceID或語音識別進行場景理解,用于行為分析,推送

-

賬號鑒權:對服務接入進行鑒權,只有授權賬號才能進行服務

-

faceID:駕駛員人臉識別

-

數據閉環管理:數據接入平臺、OTA升級等

二,智能座艙算法算力解析

智能座艙的高速發展催生算法數量攀升,算力需求增加。到2021年,攝像頭能夠覆蓋轎車乘客,IMS檢測最多達5人,多模語音分離最多也達到5人,2022年,大概有150個算法驅動300個以上的場景應用;到2023年,開發者生態建立后,第三方感知將大幅增加,全車的離線多模語音交互將需要更多的算力。車載智能化AI系統包括車載AI場景、算法、開發工具、計算架構、車載AI芯片。整個智能座艙AI系統視覺、語音、多模融合。23年,座艙AI算法將達到白萬級。

在數據方面整體提高50%的處理效率,在算法方面平衡計算和帶寬上的高效神經網絡結構。在算力上將從個位數量級向百位數量級增長,一般情況智能AI座艙是一個獨立系統,獨立迭代,每月OTA。

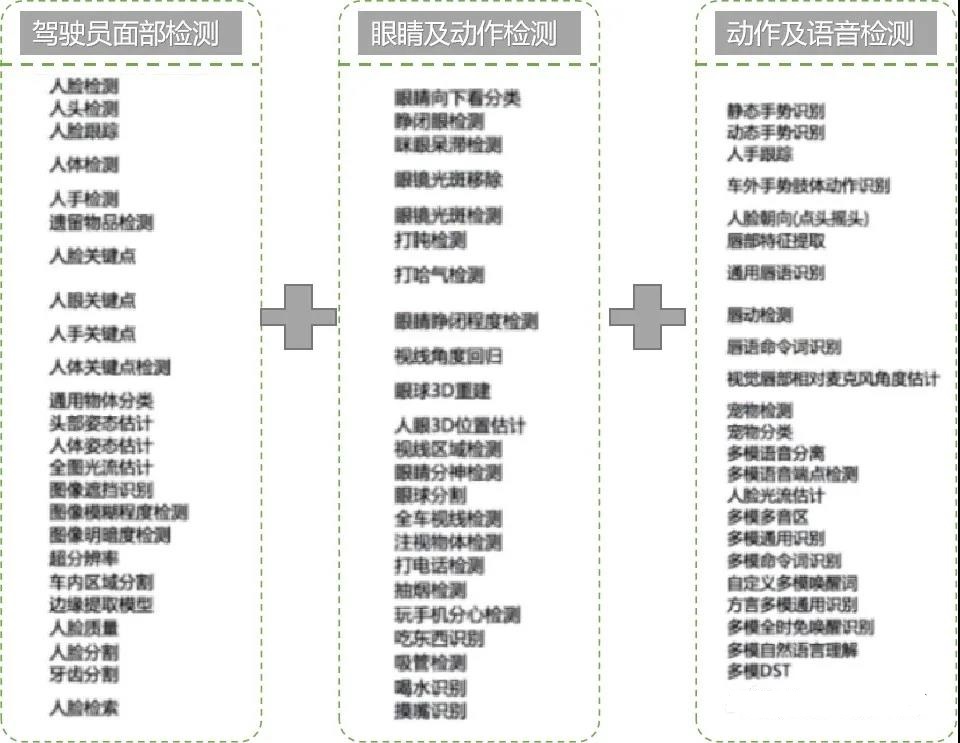

如下表示了智能座艙在其AI算法發展上的能力分配表。總結起來智能座艙算法模塊主要分為幾個大類:

駕駛員面部識別類:包含人頭識別、人眼識別、眼睛識別等;

駕駛員動作識別類:手勢動作識別、身體動作識別、嘴唇識別等;

座艙聲音識別類:前排雙音區檢測、聲紋識別、語音性別識別/年齡識別等;

座艙光線識別類:座艙氛圍燈、座艙主體背景、座艙內飾等;

如下圖表示了比較全面的智能座艙算法庫。

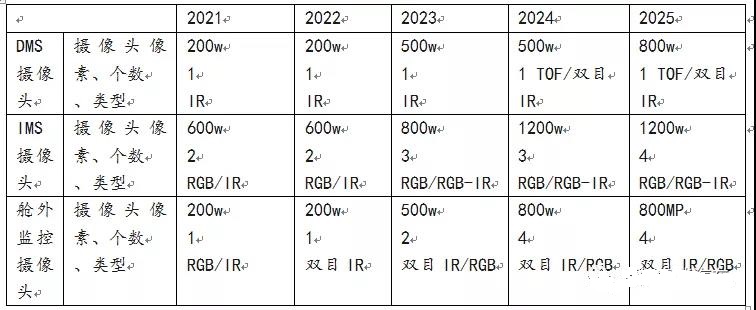

車載智能交互算力需求趨勢,表示傳感器增長趨勢主要體現在艙內傳感器數量和像素的提升,帶來對算力需求的大幅提升。此外,對于智能座艙而言,麥克風數量也從集中雙麥克風/分布式4麥克風,向分布式6-8個麥克風方向發展。

三,智能座艙開發流程

智能座艙開發流程涉及利用新場景、場景庫進行場景定義;利用HMI設計工具進行UI/UE設計(包含界面及交互邏輯設計);利用HMI 框架構建工具搭建整個交互設計平臺;由開發人員基于搭建的交互設計平臺進行軟硬件開發;測試人員深入貫穿于整個開發過程進行階段性單元測試和集成測試。測試結果部署于車端進行搭載。整個過程由開發設計人員進行全方面維護。

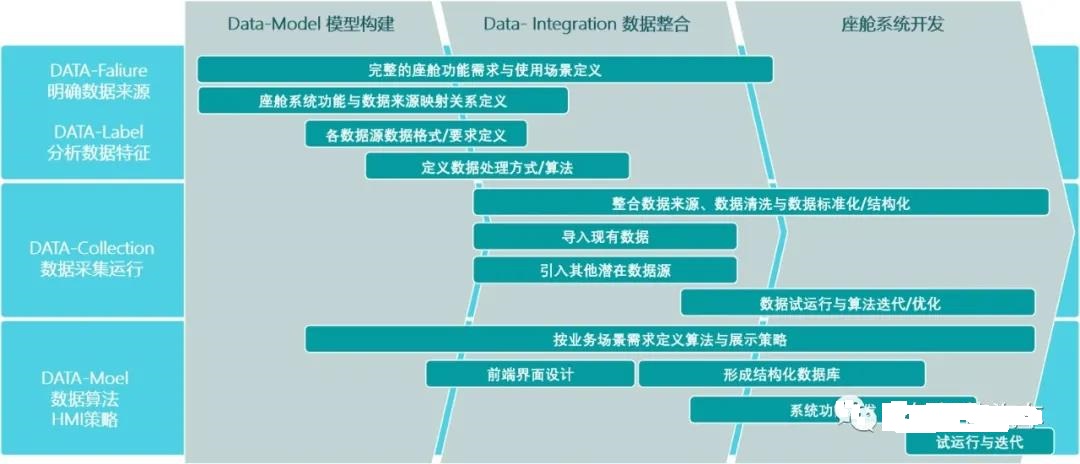

細化下來,將其中的開發過程進行放大可以看到:從數據平臺到開發平臺搭建及軟硬件開發過程涉及如下:

1、數據開發框架

整個開發數據平臺是一個全閉環流程,該閉環流程涉及四大數據處理過程,最終形成可用于訓練的的有效模型。我們將整個數據框架的閉環過程進行細化,不難發現從數據采集到數據模型整個閉環過程都是連續不間斷的過程,其過程就是不斷探索對應場景下的數據真值。其中數據采集是從數據后臺通過數據回灌進行數據挖掘服務,通過數據篩選將其中達標數據注入數據標注模塊,從而進行數據訓練,訓練過程中需要同步進行評測、同步等操作最終形成初版數據模型并進行工程集成到軟件模塊中。最后才是最重要的過程就是在功能評測階段不斷進行回歸測試與數據分類,通過OTA等在線升級方式刷寫進行車端軟件更新。

1)數據缺陷

這一過程中,首先需要從已量產的產品中提取數據缺陷DATA-Failure;數據缺陷包含數據漏檢,虛假數據,數據校驗不通過部分等;

2)數據采集

針對數據缺陷需要重新進行數據采集DATA-Collection,該采集過程包含在開發階段通過搭建的數據采集平臺進行數據采集(比如可以是實車在駕駛過程中用到的駕駛艙內外行車記錄儀、全景影像、前視或周視攝像頭等),也包含在已經量產的車型中設置的數據埋點或影子模式方式進行;

3)數據標注

采集數據進行數據標注DATA-Label,這里需要注意的是智能座艙和智能駕駛的標注方式上有所不同;如座艙主要涉及圖片、語音等標注,ADAS主要涉及道路環境語義(如車道線、護欄、錐桶等標注類型)等標注;

4)數據模型

對于智能座艙算法而言,最重要的是進行人工智能的機器視覺算法訓練,該過程涉及形成較為精準的數據模板,將標注后的數據用于進行數據模型訓練DATA-Model。

2、應用開發框架

AI算法倉庫主要是對數據平臺中的數據模型進行有效訓練,模型訓練主要高中低三種漸進開發模式。

高級模式:該AI算法倉庫中訓練模型復雜,需要耗費較多的AI算力用于權值檢測、關鍵點檢測、圖像語義分割,圖形骨架提取等;

低級模式:算法倉庫都是一些標準化模型,如安全帶、座椅識別等標準件的識別等;這種類型的識別過程都是一些標準化的識別過程,甚至不包含浮點運算,都是整型運算,算法耗費算力小,效率高;

中級模式:算法倉庫中復雜度一般,分類較多,嵌入多模型組合進行分類,可實現諸如抽煙、打電話等駕駛員基本的操作過程識別。需要說明的是該模型對于開發團隊的能力建設要求較高。

3、應用集成框架

應用集成框架平臺包含利用AI應用開發中間件集成模型框架,搭建通信及底層組件。在開發集成過程中包含模型轉換(即浮點轉定點)與編譯,生成標準化模型,隨后通過加載模型跟配置(配置可以放到固定的地方);定義輸入輸出:編寫過程代碼(包含處理邏輯),接收函數框架,定義消息類型(自動反序列化與序列化),釋放軟件等過程。后續可編譯生成.so文件,并加載到感知管道Pipeline中。

如上其他部分可以標準化,只需要關注process部分即可。

總結

本文詳細描述了新型智能座艙的開發架構與開發流程,其中開發座艙架構技術的發展,也不會一直局限于座艙域,其也適用于智能駕駛域。當前,座艙域控制器通常參與車身域的控制,如控制空調、車門、車窗等。下一代智能座艙產品將更多的參與到動力&底盤域的控制,例如通過語音控制給車輛換擋燈、拉起電子手剎等。當然,這類操作對安全性有更高要求。隨著自動駕駛系統對動力域、底盤域的不斷整合,以及面向服務架構(SOA)在車輛的普及,復雜的駕駛行為可能會抽象成個例化的駕駛服務。智能座艙域控制器通過提高自身的功能安全等級后,就可以直接調用自動駕駛域的駕駛服務,進行車輛的駕駛控制,形成人機共駕的新局面。

經過對座艙域系統的系統架構和軟硬件進行安全升級后,座艙的發展將補齊“駕駛控制”這最后一個短板,邁向“全方位智能座艙”。隨著技術逐步的成熟,可能會導致硬件架構的進一步集中,加速促成駕駛域與座艙域的融合,并最終形成車載中央計算機。

來源:焉知智能汽車